Cada vez mais sofisticados, os golpes envolvendo os deepfakes aumentaram 830% no Brasil entre 2024 e 2025, de acordo com o levantamento da BioCatch. Em um cenário de maior circulação de conteúdos digitais — como ocorre em anos eleitorais — esse avanço reacende um alerta: você saberia identificar um vídeo falso?

Neste artigo, apresentamos de forma objetiva o que são deepfakes, os principais riscos associados ao uso indevido dessa tecnologia e alguns cuidados básicos para identificar conteúdos potencialmente manipulados.

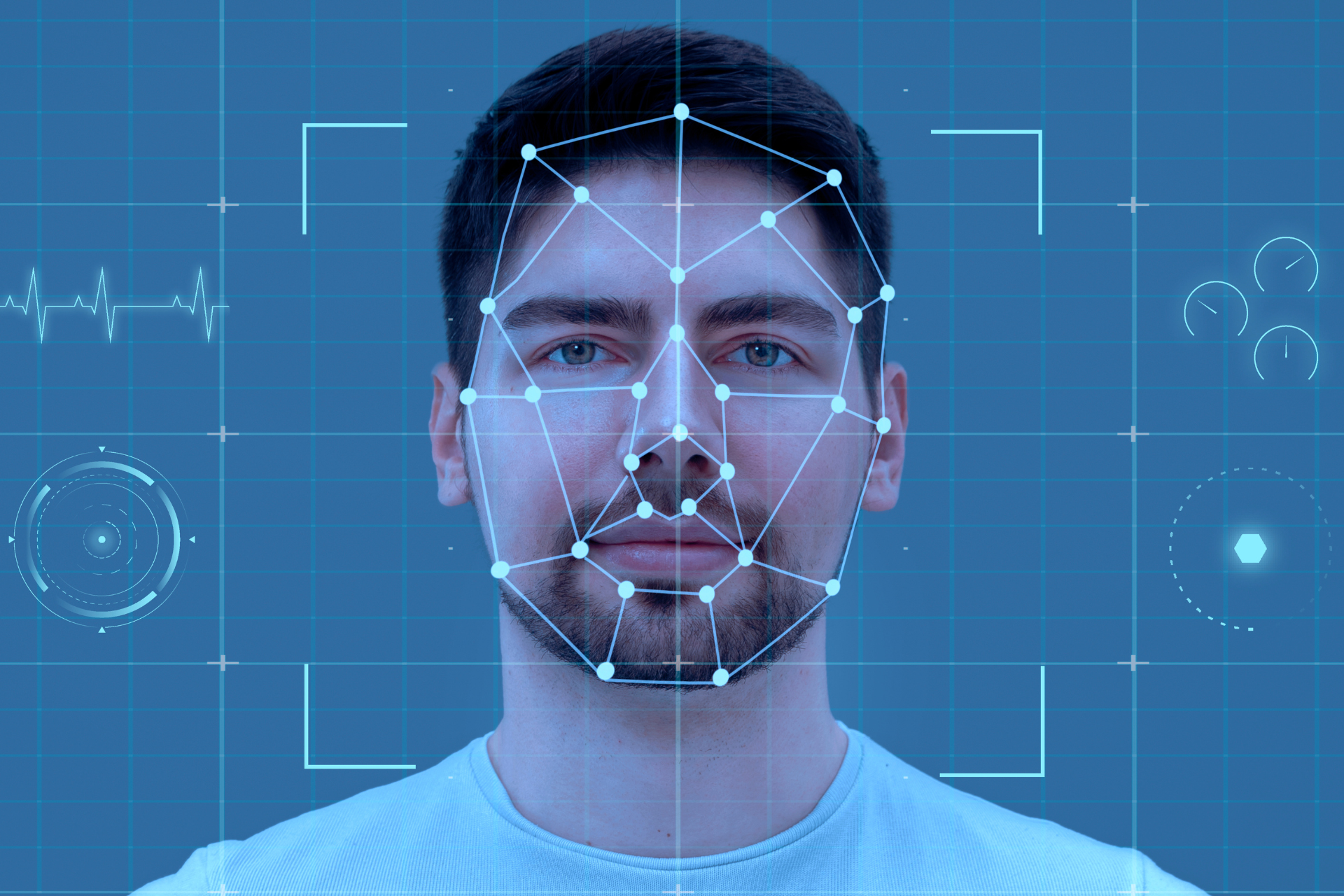

O que são deepfakes?

O termo em inglês que une as palavras “deep learning” (aprendizado profundo) e “fake” (falso), se refere ao uso de inteligência artificial para criar imagens, vídeos e até áudios que parecem verdadeiros, mas não são.

Na prática, essa tecnologia funciona a partir de algoritmos de aprendizado profundo que analisam grandes volumes de dados — como imagens, vídeos e gravações de voz — para identificar padrões de aparência, expressão e fala. Com base nesse treinamento, os sistemas passam a reproduzir esses elementos de forma sintética, gerando conteúdos que imitam pessoas com alto grau de realismo, mesmo sem que elas tenham participado da gravação original.

Deepfakes “ao vivo”

Diferentemente dos deepfakes tradicionais, que envolvem edição prévia, os chamados deepfakes “ao vivo” operam de forma instantânea. Nessa modalidade, sistemas de inteligência artificial processam e aplicam alterações em tempo real, permitindo a simulação de rostos ou vozes durante uma transmissão ou interação direta, sem etapas posteriores de edição.

Esse tipo de tecnologia depende do processamento contínuo de grandes volumes de dados visuais e sonoros, extraídos de conteúdos reais disponíveis publicamente. Quanto maior a quantidade de registros de uma pessoa — especialmente imagens e gravações de voz —, maior a precisão da simulação. Embora soluções de alta qualidade exijam infraestrutura computacional robusta, versões mais acessíveis já circulam no mercado, ampliando o alcance da prática e tornando os deepfakes em tempo real um desafio crescente para a identificação de fraudes e para a confiança nas interações digitais.

Principais riscos dos deepfakes

- Golpes financeiros e fraudes

A simulação de voz ou imagem de pessoas conhecidas, executivos ou figuras públicas pode ser usada para enganar vítimas, autorizar transferências, solicitar pagamentos ou obter dados sensíveis de forma fraudulenta.

- Extorsão e chantagem

Conteúdos falsos, mas verossímeis, podem ser utilizados para ameaçar indivíduos ou empresas, explorando danos à reputação ou constrangimentos pessoais como forma de pressão.

- Desinformação e manipulação da opinião pública

Deepfakes podem distorcer fatos, atribuir falas inexistentes a autoridades ou influenciar debates públicos, comprometendo a confiança em informações e instituições.

- Uso em contextos sensíveis e ilegais

Os deepfakes também representam um risco em situações especialmente delicadas, como a criação ou manipulação de imagens envolvendo crianças e adolescentes, além de outros usos criminosos que exigem atenção redobrada das autoridades.

Como identificar deepfakes

- Preste atenção nas expressões faciais

Deepfakes podem apresentar expressões faciais pouco naturais, como piscadas irregulares, movimentos rígidos ou reações emocionais que não correspondem ao contexto da fala.

- Analise a sincronização dos lábios com a fala

Em muitos casos, há um leve descompasso entre o movimento da boca e o áudio, especialmente em palavras mais longas ou mudanças rápidas de entonação.

- Verifique se o vídeo está em portais confiáveis

Conteúdos divulgados fora de veículos reconhecidos, sem autoria clara ou contexto verificável, merecem cautela, principalmente quando trazem declarações polêmicas ou sensacionalistas.

- Pele “perfeita” demais

Texturas excessivamente lisas, ausência de poros, sombras inconsistentes ou iluminação artificial podem indicar que a imagem foi gerada ou alterada por inteligência artificial.

- Entonação artificial ou voz pouco natural

Áudios gerados por IA podem apresentar ritmo irregular, pausas estranhas, pouca variação emocional ou uma entonação excessivamente uniforme ao longo da fala.

- Observe inconsistências visuais no ambiente

Elementos do fundo que se distorcem, mudam de posição ou apresentam falhas sutis durante o vídeo podem ser sinais de manipulação digital.

- Desconfie de conteúdos que provocam urgência ou forte apelo emocional

Deepfakes costumam ser usados em golpes ou campanhas de desinformação que estimulam reações rápidas, sem tempo para checagem ou reflexão.

Os deepfakes não são usados só para o mal

O uso de deepfakes não se restringe apenas para práticas nocivas, essa tecnologia também pode ser utilizada de forma positiva em áreas como educação e comunicação pública, ao viabilizar conteúdos didáticos mais acessíveis e inclusivos. Personagens virtuais realistas podem ser criados para explicar temas complexos, simular situações históricas ou transmitir orientações de interesse coletivo, com adaptação para diferentes idiomas e públicos, o que amplia o alcance da informação sem a necessidade de múltiplas gravações presenciais.

A medicina e a acessibilidade também aparecem entre os campos que podem se beneficiar dessa tecnologia. Segundo a Encyclopedia Britannica, o uso de deepfakes pode permitir que determinadas pesquisas sejam conduzidas sem a necessidade de pacientes reais. Além disso, a tecnologia pode apoiar recursos de acessibilidade, como intérpretes virtuais de Libras e adaptações visuais de conteúdos, ampliando o acesso à informação para pessoas com deficiência.